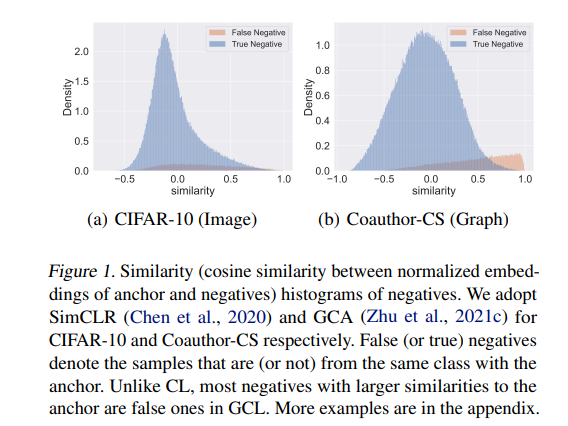

最近的研究表明,难的负样本(与锚点样本更相似的负样本)可以提高对比学习的表现。然而,作者发现现有的其他领域的难负样本挖掘技术并不能很好地促进图对比学习(参见原文Table 5)。作者对此现象进行了实验和理论分析,发现可以归因于图神经网络的消息传递机制。如果像其他领域那样仅仅把相似度做为衡量负样本难易程度的指标,在图对比学习中大多数的难负样本是潜在的假负样本(与锚点样本同一类, Figure 1)。为了弥补这一缺陷,作者利用混合分布来估计负样本为真负样本的概率,并设计了两种方案(即 ProGCL-weight 和 ProGCL-mix)来提高 GCL 的性能。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...