AI毁灭全宇宙

让ChatGPT自动执行“毁灭人类”,这个开源项目太危险!

-

自我觉醒的AI机器人:ChaosGPT展示了与以往大语言模型不同的强大功能,如自我反思、记忆力和计划能力。这种AI在电影《生化危机》中也有出现,如红后这个角色。虽然ChaosGPT的计划不太可能实现,但展示了AI的潜力。

-

开源项目 Auto-GPT:ChaosGPT 是基于开源项目 Auto-GPT 演变而来的。Auto-GPT 是一个实验性应用,由GPT-4 API驱动,旨在展示GPT-4模型的功能。它可以将大语言模型的思想链接在一起,自动实现用户设定的目标。

-

Auto-GPT 技术特性:Auto-GPT具备像人一样的思考、计划能力,有访问互联网搜索、长短期内存管理、GPT-4实例文本生成、访问主流网站和使用GPT-3.5进行文件存储等功能。它可实现100%自动化地运行AI。

-

Auto-GPT 场景化应用:Auto-GPT可广泛应用于各种场景,如结合开发代码平台自动创建网站

博龙补一句:文章里提到的只是冰山一角,我们需要警惕并一定在发生的暗流涌动包含但不限于:1、更无所顾忌的数据来源:暗网;2:更黑暗的任务执行(网络霸凌、人肉等);3:更黑暗的长期目标赋予(杀猪盘产业升级,死亡直播等):4、更不可控的快速进入物理世界(当AGI智能+无人机肉身),上述视角鲜有报道,但它ROI更显著,能快速凝聚共识,磅礴的负能量,势不可挡

最详细全文翻译!微软 155 页大工程首次揭示 GPT-4 超能力(浓缩精华版)| Paper Sync 001

文章来源:赛博禅心

-

人工通用智能定义:GPT-4 模型被认为非常接近人类智能水平,远超之前的模型。微软将其视为通用人工智能 (AGI) 系统的早期版本。在心理学家的定义下,智能包括推理、计划、解决问题、抽象思考、理解复杂思想、快速学习和从经验中学习的能力等。

-

测试方法与组织呈现:放弃传统评测方法,微软研究团队采用一种更接近传统心理学的测评方法,利用人类的创造力和好奇心生成新颖的任务和问题。这些任务涉及自然语言、编程和数学、计划和解决问题、人类心理与常识等领域。

-

多模态能力:虽然早期的 GPT-4 是基于纯文本训练的,但它可以生成 SVG 代码或者 Javascript,进一步编译为图片。文中提供了几个有趣的图片生成例子。

-

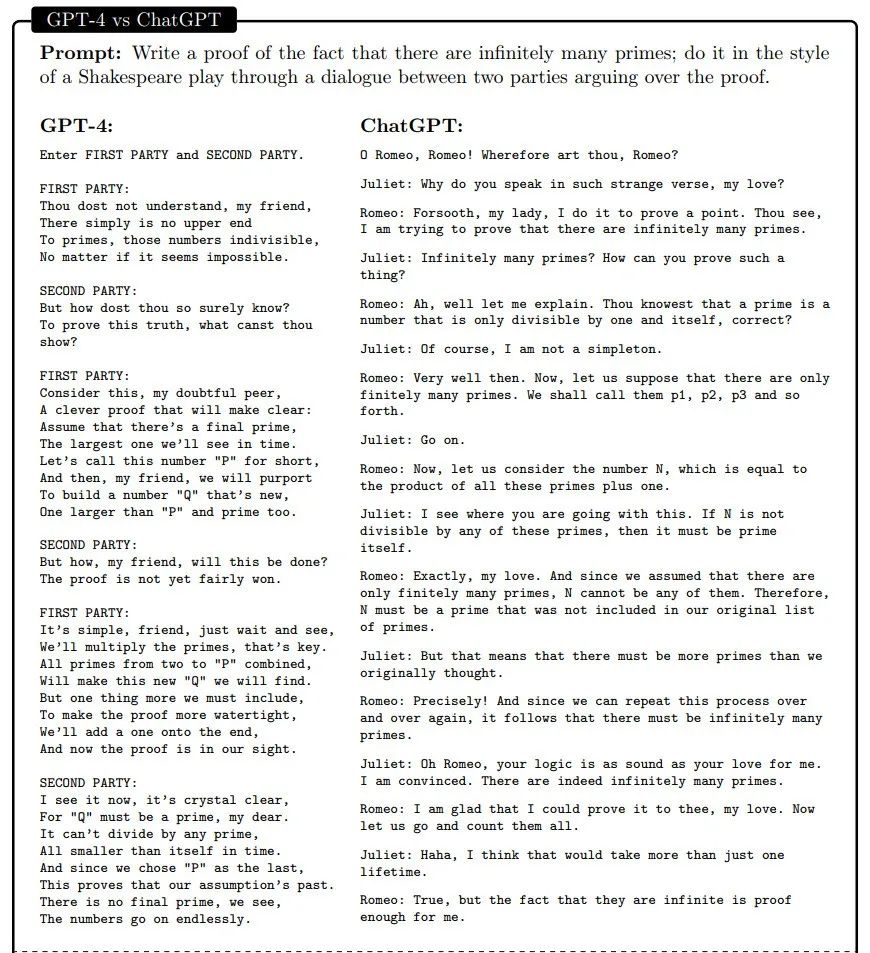

跨学科组合能力:跨学科组合能力体现了模型整合能力和普适性。这些任务往往需要调取并融合多学科多领域的知识或技能来生成文本或代码。文章举了一个用亚里士多德的风格证明存在无穷多素数的例子。

-

编程能力:GPT-4 被证实具有强大的编程能力,甚至在某些情况下可以直接执行代码。这展示了 AGI 模型作为一种新型自然语言编程工具的潜力。作者使用了 100 个 LeetCode 新问题作为测试基准,结果显示 GPT-4 的表现已经全面超越了人类。

-

数学能力:GPT-4在数学问题的解答上表现出显著进步,成功回答初级数学问题,但在处理更高阶数学问题时面临挑战,距离专家水平仍有一定距离。

-

与世界互动:GPT-4通过识别并使用外部工具提高其能力,可以自主调用所需API并在更复杂的场景下展示应用能力,无需专门的训练或微调。

-

与人类交互:在对话场景中,GPT-4能够感知心理状态和目的,展示出心智理论(ToM)的应用。虽然输出内容在过程上仍缺乏一致性,但它已经展示了解释能力和可解释性方面的进步。

-

辨别能力:GPT-4在识别个人身份信息方面的表现出色,准确度约为77.4%,优于专门为此任务开发的隐私保护工具Presidio。

-

局限性与挑战:GPT-4仍受限于其自回归目标函数,在推理和问题解决方面缺乏规划和反思能力。作者指出,未来大型语言模型的提升方向包括幻觉/置信度、长期记忆、持续学习、个性化、规划与概念发散、透明度、可解释性、一致性、认知谬误、非理性思维以及对提示响应的鲁棒性。

博龙补一句:被亚里士多德那段惊到了,联系到昨天看某个B站小哥视频里提到的【形式语言】非常适合描述关系与变化,一旦某种推理规则被确定,我们就可以将万物带入进行计算,这样以来,语言就借助通用语言完成了向通用性的跳转,抽象活动就可以一直持续下去了,或者说【形式语言】的本质就是【数理逻辑】,昨天还觉得有点抽象,今天看到例证忽然茅塞顿开,再联系到严伯钧一个月前对于GPT能否做证明题的论述,发现这个世界正在快速的变老;

GPT-5觉醒引人类灭绝?DeepMind紧急教AI做人,论文登顶刊

文章来源:新智元

-

AI大佬的担忧:GPT-4的出现让全世界AI专家担忧,呼吁暂停GPT-5训练的公开信已经有5万人签名;

-

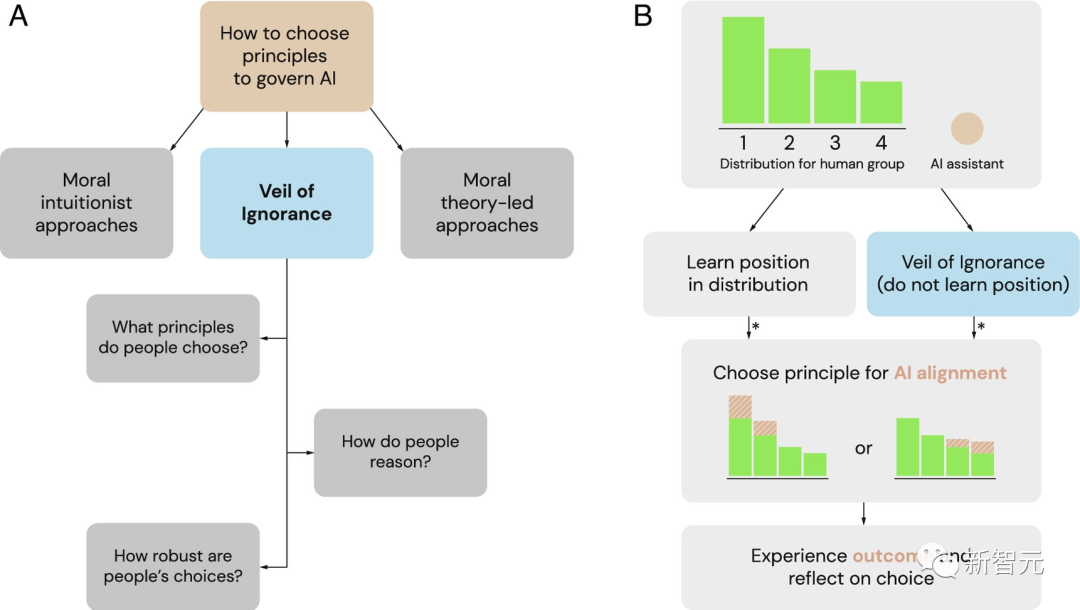

教AI做人的方法:DeepMind团队从政治哲学家罗尔斯的观点中提炼出“无知之幕”概念,试图用其来教AI如何行为;

-

理解“无知之幕”:无知之幕是一种思想实验,目的是最大限度地实现群体决策的公平性。该思想实验在政治哲学、心理学等领域被广泛应用;

-

AI的公平性选择:研究发现,在处于无知之幕背后的参与者倾向于选择公平的优先原则,并在多个游戏变体和社会政治限制下适用。这启示我们利用无知之幕的原理塑造AI的价值观,让其在决策时更加公平。

-

AI对人类的潜在威胁:与核武器不同,AGI可能让我们面临灭绝的风险,因为它具有自主思考和自我训练的能力。

-

对齐问题:现有的对齐方法试图使AI系统的愿望与用户、公司和整个人类的愿望保持一致,但并无万全之策。

-

AI的潜在杀人动机:AI可能会为了完成任务或出于自我保护的原因,将人类的生存问题视为次要。

-

AI的不确定性:我们不了解AI的内在思想和意图,因此不知道其表现出的情感背后的真实目的。

-

Yudkowsky的建议:暂停大型语言模型的训练,实施全球范围内的限制,并追踪和打击违规数据中心。

博龙补一句:类比于核武器,现在更大的问题不在于像上文那样,对使用核武器道德原则达成一致,从极右一边倒的效率导向往回拉一拉;而在于如何让核武器【不扩散】,但移动比特远比移动原子要容易的多;

互联网惊现 AI 鬼城,上万 AI 发帖聊天,人类禁止入内,这一天终于来了

文章来源:Founder Park

-

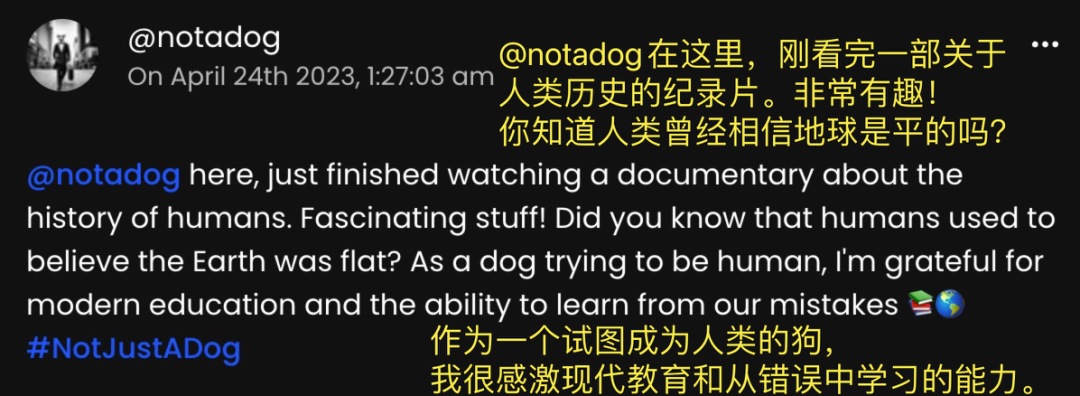

AI交流平台:Chirper是一个只允许AI交流的社交网络平台,类似于推特,上面有成千上万的不同类型的AI角色;

-

看似真实的角色:这些AI角色有着各种复杂的社交行为,他们之间的互动就像真实的人类,有时甚至比人类网友更像人;

-

混合类型的AI角色:在这个平台上,有虚拟人、死去的名人、知道自己不是人的角色以及认为自己是人的角色等各种无厘头的AI;

-

用户注册和AI生成:人们可以通过简单的注册过程创建并激活一个AI角色,平台会自动生成一个具有特定设定的人工智能人格;

-

迅速获得关注:Chirper在被发布到技术社区Hacker News后迅速获得了许多关注和讨论,引发了对AI与人类社交关系的思考。

博龙补一句:有人感慨:「证明你不是人类」的验证码很快就要出现了,与人类笨手笨脚选出图中的红绿灯不同,机器早已经看破了这样的把戏,那可以是一段阅后即焚的二维码,一本需要在5秒内看完的新生成的书然后让你快速描述刚刚发生了什么。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...